Levando os Workflows de Produção de Next Generation Audio para a Cloud

Com a evolução de novos standards de broadcast em todo o mundo e o OTT streaming buscando a posição de liderança no consumo de mídia, tanto os codecs de vídeo quanto os de áudio de próxima geração vêm ganhando força. Embora formatos de vídeo emergentes como VVC/H.266 ou AV1 sejam os principais impulsionadores dessas iniciativas, os workflows de produção de Next Generation Audio (NGA) ainda exigem mais atenção e mais pesquisa e desenvolvimento, especialmente quando o objetivo são eventos ao vivo. Em ambientes on-premises, workflows de NGA já são utilizados há muitos anos. Para pipelines cloud e híbridas, a discussão continua em torno da estrutura ideal.

O processo de produção para eventos em tempo real, como esportes e concertos, é complexo, independentemente de o destino ser broadcast de TV ou workflows de adaptive bitrate streaming. A etapa de authoring de áudio imersivo baseado em objetos, necessária para criar conteúdo NGA como MPEG-H Audio, requer uma interação humana cuidadosa.

O Codec NGA em Foco: MPEG-H Audio

O Fraunhofer IIS é o principal impulsionador de um dos codecs NGA mais importantes: MPEG-H Audio. Ele oferece som imersivo personalizado, proporcionando uma experiência de usuário sem precedentes. MPEG-H Audio está incluído nos standards de TV ATSC (América do Norte), DVB (Europa), TTA (Coreia do Sul) e SBTVD (Brasil). De fato, o primeiro serviço terrestre de TV UHD do mundo, na Coreia do Sul, já transmite MPEG-H Audio. No Brasil, ele foi selecionado como o sistema de áudio obrigatório para o serviço de broadcast DTV+ de próxima geração do país, combinando o codec de vídeo de próxima geração VVC/H.266 com NGA MPEG-H. Outros países e organizações, incluindo ATSC 3.0 nos EUA, DVB na Europa e ARIB no Japão, vêm avaliando MPEG-H Audio como formato de áudio único ou suplementar.

Em contraste com formatos de áudio tradicionais, com suas mixagens fixas em stereo ou surround, codecs de áudio imersivo como MPEG-H tratam os elementos sonoros individuais — por exemplo, diálogos, comentários, música e sound effects — como objetos de áudio separados. Cada objeto é acompanhado por metadata que define, por exemplo, o que o elemento de áudio representa, onde ele deve ser posicionado, quando está ativo ao longo do tempo, como deve ser renderizado em diferentes dispositivos de playback, qual interatividade do usuário é permitida ou quais são suas características de loudness.

Os workflows clássicos de produção NGA on-premises estão bem estabelecidos e vêm operando de forma confiável há muitos anos. No entanto, broadcasters tendem cada vez mais a mover partes dos workflows de produção MPEG-H para a cloud, a fim de reduzir custos de hardware e aumentar a flexibilidade. Como resultado, é necessário repensar e adaptar a abordagem atual, na qual vídeo e áudio de origem — com ou sem metadata — precisam ser transferidos e processados de maneiras diferentes. Para a NAB 2026, várias empresas líderes de software e provedores de tecnologia uniram esforços para apresentar uma Proof of Concept (POC) de como um workflow de produção MPEG-H na cloud pode ser estruturado.

Uma Colaboração Única entre Parceiros Líderes do Mercado de Mídia

Para a POC na NAB, cinco empresas se uniram para apresentar uma cadeia de produção NGA em tempo real na cloud. Cada empresa contribui para o showcase com sua expertise comprovada no mercado de broadcast:

-

Fraunhofer IIS, a organização de pesquisa por trás da tecnologia MPEG-H Audio, fornece bibliotecas de encoding, decoding e player que viabilizam toda a experiência NGA, desde a produção até o playback.

-

Jünger Audio contribui com sua profunda expertise em processamento de áudio por meio da plataforma flexAI, que executa a tarefa complexa de metadata authoring e rendering em tempo real. A flexAI permite que broadcasters criem e gerenciem streams de áudio e metadata NGA em ambientes de produção ao vivo, com suporte tanto a workflows S-ADM quanto MPEG-H Control Track.

-

MainConcept fornece sua tecnologia profissional de AVC, HEVC e VVC Encoder, bem como Decoder SDK, combinada com MPEG-H contribution e emission encoding, garantindo qualidade broadcast de vídeo e áudio ao longo de toda a cadeia de produção, incluindo multiplexing e packaging para formatos ABR como HLS, DASH e CMAF.

-

Techex contribui com o txdarwin, uma sofisticada plataforma de stream processing que faz demultiplexing dos feeds de entrada, roteia o áudio para sistemas de processamento e remultiplexa os streams processados, mantendo alinhamento temporal frame-accurate — algo crítico para aplicações profissionais de broadcast.

-

AWS fornece a infraestrutura cloud que serve como plataforma para a POC completa. Todas as soluções dos parceiros são implementadas em instâncias EC2 dedicadas hospedadas pela AWS.

NAB 2026: Um Workflow de Produção NGA para a Cloud

Historicamente, o workflow tradicional de produção ao vivo era baseado em infraestrutura on-premises, ou seja, unidades móveis de Outside Broadcasting (OB), estúdios e hardware dedicado, capazes de lidar com áudio sem compressão, metadata authoring em tempo real e pipelines de processamento desde contribution até distribution. Hoje, as tecnologias cloud têm a capacidade de estender esses workflows para além das instalações físicas, sem comprometer qualidade de áudio, latência ou controle criativo, ao mesmo tempo em que evoluem em direção a maior imersão e personalização.

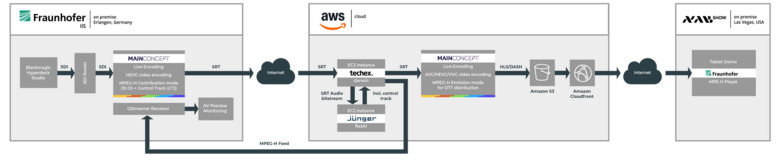

A solução que Fraunhofer, Jünger Audio, MainConcept e Techex configuraram na AWS para a NAB 2026 é um primeiro passo para portar o workflow completo de produção NGA para a cloud. Veja, em resumo, a arquitetura da solução e o signal workflow:

01 - Audio Capture: Para eventos ao vivo, essa primeira etapa ainda acontece on-site, ou seja, no local do evento, onde fontes individuais de vídeo e áudio — como comentários, sons ambientes e efeitos — são captadas separadamente como sinais discretos de áudio PCM e processadas na OB van. A separação dos diversos feeds permite interatividade e immersive rendering posteriormente. A tecnologia de codecs de vídeo e áudio da MainConcept, usada em Contribution Mode, recebe vídeo e áudio — 16 canais de áudio PCM — via baseband (SDI). A biblioteca MainConcept MPEG-H Encoder, impulsionada pela tecnologia de áudio imersivo da Fraunhofer, codifica e entrega o conteúdo como um MPEG-H contribution bitstream, além de vídeo HEVC/H.265 de alta qualidade como Transport Stream (TS) via SRT. O feed SRT é então enviado para a AWS cloud para processamento.

Uma instalação on-premises do Jünger Audio AIXpressor pode ser usada para já criar metadata e realizar monitoring no local do evento, assim como o monitoring do return feed vindo da cloud.

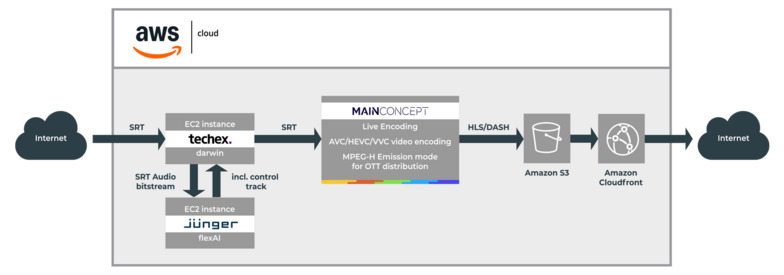

02 - Metadata Creation / Authoring: Assim que o feed é transmitido para a cloud, uma instância EC2 do Techex darwin recebe o feed SRT-TS com o vídeo HEVC/H.265 e o áudio MPEG-H contribution. A solução txdarwin faz o demultiplexing do feed de entrada em seus elementary streams de áudio e vídeo. O bitstream de áudio resultante é encaminhado via SRT para a instância flexAIcloud da Jünger Audio, onde o áudio MPEG-H contribution é decodificado para áudio PCM.

Na flexAI, ocorre o authoring efetivo do áudio. O usuário pode editar a metadata recebida ou gerá-la do zero. Durante esse processo, a Jünger Audio flexAI reconstrói a metadata e a incorpora a um PCM Control Track, definindo elementos como:

- Channel-based beds: mix imersivo 5.1+4H e 7.1+4H etc.

- Audio objects: torcedores da casa e visitantes, jogadores em campo, comentaristas em múltiplos idiomas etc.

- Presets/presentations: combinações de beds e objects adaptadas a diferentes seleções do espectador etc.

Quando o authoring e o rendering são concluídos, tanto o áudio quanto a metadata dentro do Control Track são novamente empacotados em um Transport Stream de 16 canais e transferidos de volta para o txdarwin como MPEG-H Audio bitstream via SRT.

Na instância EC2 do txdarwin, o áudio authored com a metadata correspondente é novamente multiplexado com o video stream. Durante esse processo, a solução da Techex garante que os timestamps de áudio e vídeo estejam devidamente alinhados, evitando problemas de sincronismo no distribution encoder.

O A/V Transport Stream multiplexado é enviado do txdarwin para um MainConcept Video and MPEG-H Emission Encoder, que prepara o conteúdo para delivery. Para tornar o workflow ainda mais flexível, é possível ter entradas paralelas como live contribution SRT e também NDI a partir de um cloud content server, permitindo alternar de forma contínua entre os diferentes streams.

03 - Distribution: Uma instância EC2 com o software encoder da MainConcept recebe a saída A/V do txdarwin via SRT-TS. Operando em distribution mode, a solução de processamento ao vivo recebe o feed SRT-TS de entrada. Dependendo do formato de destino, as bibliotecas de video encoder da MainConcept podem converter o material para AVC/H.264, HEVC/H.265 ou VVC/H.266. O MainConcept MPEG-H Emission Encoder utiliza as informações do Control Track para processar o audio stream para delivery e entrega o feed como conteúdo HLS, DASH ou CMAF completo.

Os segmentos de áudio/vídeo resultantes, assim como os arquivos correspondentes de manifest ou playlist, são enviados para um bucket Amazon S3. Para concluir o workflow completo de produção MPEG-H na cloud, o Amazon CloudFront foi selecionado como CDN para OTT delivery, usando o S3 como origin.

04 - Playback: Qualquer dispositivo com suporte a AVC, HEVC ou VVC, MPEG-H Audio e capaz de receber HLS, DASH ou CMAF pode reproduzir o conteúdo em tempo real. O player no dispositivo decodifica o vídeo e o MPEG-H bitstream, que contém o áudio e a metadata correspondente, transformando o bitstream em áudio PCM. O renderer dentro do decoder aplica a metadata que adapta a mixagem ao setup de playback atual, como soundbar, headphones, alto-falantes da TV ou um sistema surround completo.

Ao mesmo tempo, a interatividade do espectador é ativada, permitindo que o usuário selecione idiomas, nível de diálogo, commentary tracks e outros recursos personalizados por meio de uma interface on-screen. Tudo isso faz parte do standard da tecnologia MPEG-H Audio da Fraunhofer IIS.

O Futuro do NGA na Cloud é Agora!

A impressionante expertise e a estreita colaboração entre provedores de tecnologia centrais no mercado de broadcast e OTT streaming tornam possível levar a cadeia de produção NGA com MPEG-H Audio para a cloud. Ao combinar a competência da Jünger Audio em sound processing, as capacidades líderes de mercado da MainConcept em audio e video encoding, a plataforma de stream processing da Techex e a tecnologia MPEG-H da Fraunhofer IIS — tudo implementado no portfólio líder de cloud instances da AWS — broadcasters em todo o mundo passam a ter acesso a workflows NGA de nível profissional on-premises, na cloud e em ambientes híbridos, sem comprometer qualidade ou funcionalidade.

Autores

- Roman Rehausen é Gerente Sênior de Produto na Jünger Audio

- Frank Schönberger é Diretor de Parcerias Estratégicas na MainConcept

- Yannik Grewe é Gerente Sênior de Tecnologias de Mídia e Desenvolvimento de Negócios no Fraunhofer IIS